📢 Entenda a Lei de IA aprovada nos EUA

SB 53, o projeto de lei histórico sobre transparência em IA, agora é lei na Califórnia. A legislação, muito debatida, estabelece requisitos de relatórios de segurança para grandes empresas de IA.

Em 29 de setembro de 2025, o governador da California assinou a SB 53, tornando o estado o primeiro nos EUA a regular especificamente modelos de IA. E olha, essa história tem plot twist.

Exatamente um ano antes, Newsom tinha vetado a SB 1047, uma lei bem mais pesada que queria responsabilizar empresas por danos causados por suas IAs. A galera da tech surtou, lobby pesado rolou solto, e o governador mandou: “calma, vamos com calma”. Ele chamou cientistas de Stanford, UC Berkeley e Carnegie Endowment pra criar uma solução melhor. Resultado? Um relatório de 53 páginas que virou a base da SB 53.

O que mudou?

A grande sacada foi trocar “responsabilização por danos” por “transparência com verificação”. Tipo assim: a lei anterior queria punir empresas se a IA delas causasse estrago. A nova diz: “tá, vocês podem fazer sua IA do jeito que quiserem, mas têm que contar pra gente como estão fazendo”. Nada de kill switches obrigatórios, nada de testes governamentais. Só: sejam transparentes.

Considerando que tudo que você compra de alimentos indica os ingredientes, não vejo problema em ter leis parecidas para os ingredientes de uma IA.

Quem tá na mira?

A lei só pega os peixes grandes. Estamos falando de modelos que custaram mais de $100 milhões para treinar (com poder computacional acima de 10^26 FLOPs, pra quem curte números). E as obrigações mais pesadas? Só para empresas com receita anual acima de $500 milhões. Startups podem respirar aliviadas.

O que as empresas precisam fazer?

Basicamente quatro coisas:

Publicar um framework mostrando como incorporam padrões de segurança, como avaliam riscos catastróficos, quais são suas práticas de governança.

Lançar relatórios de transparência antes de soltar um modelo novo, explicando capacidades, limitações e riscos.

Reportar incidentes críticos de segurança em até 15 dias (ou 24 horas se o bagulho for urgente).

Enviar resumos trimestrais confidenciais sobre avaliações de risco.

A lei também protege whistleblowers de forma séria. Se você trabalha com IA e vê algo perigoso rolando, pode denunciar anonimamente sem medo de ser demitido.

O povo aprova?

O YouGov encontrou 78% dos eleitores americanos apoiando regulação de IA, com 80% achando que Newsom deveria assinar. Na Califórnia especificamente, entre 65% e 77% dos californianos apoiavam exigir testes de segurança nas IAs, dependendo da pesquisa.

Entre cientistas? Divisão. Geoffrey Hinton (ganhador do Nobel de Física 2024) e Yoshua Bengio apoiaram forte. Mas Fei-Fei Li, a “madrinha da IA”, se opôs dizendo que sufocaria inovação. Mas, vale mencionar que ela foi escolhida pelo governador pra co-liderar o grupo que criou a SB 53 mais suave.

Impactos esperados

A lei entra em vigor em 1º de janeiro de 2026, e os efeitos práticos são gerenciáveis. Empresas vão precisar de equipes de compliance, sistemas de monitoramento e documentação extensiva.

As multas? Até $1 milhão por violação. Parece muito, mas é fichinha comparado com o que poderia ter sido (a SB 1047 permitia penalidades de 10-30% do custo de treinamento, tipo centenas de milhões).

O grande impacto mesmo é político. Nova York já tá copiando o modelo. Colorado aprovou sua própria lei de IA. Com o Congresso americano completamente travado em regulação tech, os estados tão tomando a frente.

Nos próximos anos vamos descobrir se essa aposta valeu a pena.

OpenAI lança TikTok de deepfakes | Tecnologia

A OpenAI acabou de lançar o Sora 2 junto com um app social que é basicamente “TikTok, mas você pode virar seu amigo usando IA”. O app (só pra iPhone e só pros gringos por enquanto) deixa você gravar vídeos e dar permissão pros seus amigos gerarem deepfakes com a sua cara. A pessoa que teve a cara clonada vira “co-dona” do vídeo e pode deletar quando quiser. Por enquanto, figuras públicas não podem ser geradas a menos que elas mesmas façam upload — mas a OpenAI já deixou claro que isso pode mudar. Vale mencionar que o Meta lançou o Vibes na mesma linha.

Comprando direto no ChatGPT | Negócios

700 milhões de pessoas já usam o ChatGPT toda semana, e agora a OpenAI quer que você compre suas coisas direto no chat. Lançaram o “Instant Checkout” que funciona com lojistas da Etsy (e logo Shopify tipo SKIMS e Glossier). A sacada: você pergunta “melhores tênis de corrida por menos de $100”, o ChatGPT mostra opções orgânicas (sem patrocínio), você clica em “Comprar” e finaliza tudo ali mesmo. O backend usa um protocolo que a OpenAI desenvolveu com a Stripe chamado “Agentic Commerce Protocol” - e é open source, então qualquer loja pode integrar. Comerciantes pagam uma taxa pequena, você não paga nada a mais. Por enquanto só pros gringos.

xAI contratando tutor de video games | Tecnologia

A xAI do Elon Musk tá contratando um “Video Games Tutor” pagando entre $45 e $100 por hora para treinar o Grok em conceitos, mecânicas e geração de jogos. Os requisitos incluem expertise em game design, portfólio de projetos indie, e “ter dedicado muito tempo jogando video games” como qualificação preferencial. O trabalho é presencial 5 dias por semana em Palo Alto, mas tem opção remota para quem for “fortemente auto-motivado” — irônico considerando que o Musk é um dos maiores críticos de home office que existe.

Mercado de trabalho virou caça ao unicórnio | Negócios

Nunca teve tanto talento tech disponível no mercado (faculdades dobraram formandos em ciência da computação de 2013 a 2022, layoffs em massa nas big techs), mas empresas dizem que não acham gente qualificada. O motivo? Só querem contratar gênios de AI — literalmente “centenas de pessoas no mundo”, segundo o CEO da Runway — oferecendo salários base de até $500 mil. Startups preferem deixar vagas abertas por meses ou anos esperando o candidato perfeito que trabalhe 7 dias por semana, enquanto engenheiros seniores com 25 anos de experiência tipo James Strawn (demitido da Adobe) conseguem uma entrevista desde o layoff. As empresas focam em contratar “10x engineers” (um engenheiro que vale por 10) e automatizar o resto, criando poucos super ricos e muitos desempregados.

JPMorgan domina IA nos bancos | Negócios

O JPMorgan Chase tem mais pesquisadores de IA que seus sete maiores competidores somados, segundo o índice Evident AI. O banco vem investindo em IA desde 2018 (antes do hype do ChatGPT), tem mais de 400 casos de uso ativos, e espera quase $2 bilhões em retorno só esse ano principalmente em prevenção de fraude. O dado mais assustador: os top 10 bancos estão melhorando em adoção de IA duas vezes mais rápido que os outros 40 do ranking, criando um gap que pode se tornar impossível de fechar em 18 meses segundo a Evident. Morgan Stanley foi a estrela em ascensão, subindo 7 posições depois de virar parceiro exclusivo da OpenAI em wealth management.

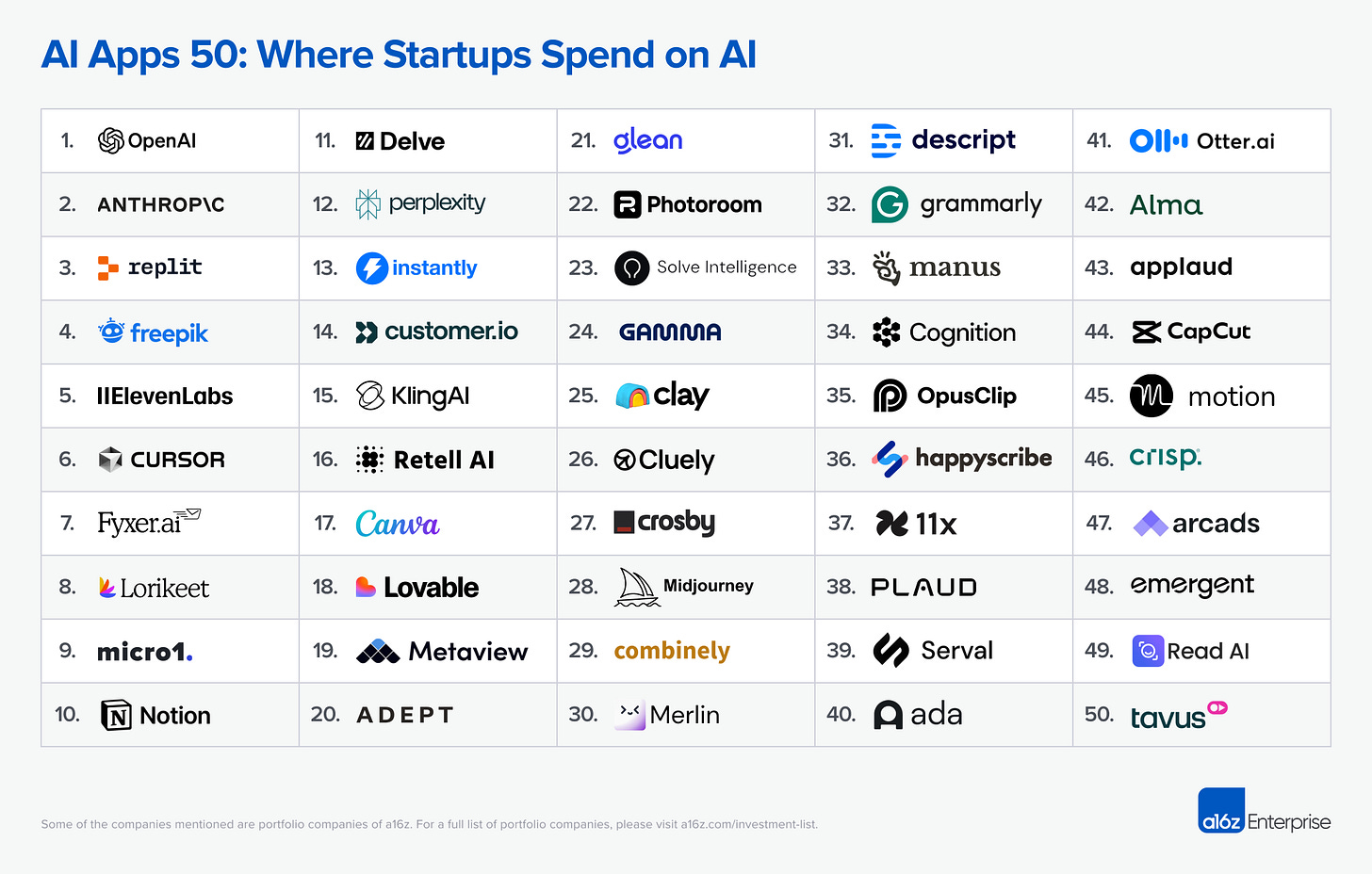

A a16z fez um relatório indicando quais são as 50 ferramentas de IA que mais são contratadas. A16z fez parceria com o Mercury (fintech que atende +200 mil startups) para rastrear onde o dinheiro realmente vai quando startups compram ferramentas de IA. Analisaram 3 meses de transações e montaram um top 50 de aplicações de IA mais usadas.

O achado mais interessante: 60% do gasto vai para ferramentas horizontais (que qualquer um usa) vs 40% verticais (específicas por função).

Categorias que dominam: ferramentas criativas lideram (10 empresas), seguidas de assistentes de reunião, customer service, e GTM/vendas. Mas o mais curioso é ver categorias que antes eram verticais virando horizontais - tipo design e programação, que agora qualquer um mexe.

Fica o alerta: use IA pra escalar execução, não pra terceirizar pensamento estratégico. Seu cérebro é músculo - se você delega tudo pra IA, ele atrofia. E quando você precisar pensar sozinho de novo, pode não conseguir mais.

Um estudo do MIT que acompanhou pessoas usando ChatGPT por 4 meses soltou uns dados de cair o queixo. 83% dos usuários não conseguiam lembrar de NADA do que tinham escrito minutos depois de usar o LLM. Zero. Nada. Página em branco.

Pior: a conectividade neural deles estava mais fraca que a de quem usava Google ou escrevia do zero. Os pesquisadores mediram isso com EEG e viram as redes alpha, beta, theta e delta literalmente desligando. O cérebro tava em modo passivo, só consumindo em vez de processar.

Mas a descoberta mais assustadora veio na quarta sessão do experimento. Os pesquisadores trocaram os grupos - forçaram os usuários crônicos de LLM a escreverem sozinhos, e deixaram quem sempre escreveu sozinho usar IA pela primeira vez.

Resultado? Quem tinha usado LLM por meses se saiu PIOR escrevendo sozinho do que no início do estudo. O cérebro tinha literalmente desaprendido a pensar de forma independente. Enquanto isso, quem sempre pensou sozinho e só usou LLM na última rodada manteve conectividade neural MAIOR que os usuários crônicos.

Os pesquisadores chamam isso de “acúmulo de dívida cognitiva”. É tipo dívida técnica, mas pro seu cérebro. Você ganha produtividade imediata, mas compromete sua capacidade de pensamento profundo no longo prazo. Os textos gerados ficavam todos iguais, homogêneos, com as mesmas estruturas e vícios de linguagem do ChatGPT.

A conclusão é brutal: enquanto os benefícios iniciais eram evidentes, ao longo de 4 meses os participantes do grupo LLM tiveram desempenho PIOR que os do grupo que não usou nada - em todos os níveis: neural, linguístico e de pontuação.

O interessante é que quem usou Google Search se saiu bem melhor. Por quê? Porque você ainda precisa processar os resultados, integrar informações, construir seu próprio raciocínio. O LLM entrega tudo pronto, mastigado, e seu cérebro entra em modo standby.

Essa semana será sem prompt para você colocar a cabeça um pouco para pensar 😂

Eu sei que dá para perceber elementos de IA nesse vídeo, mas cara, não dá para negar que ele está impressionante. O Sora 2 basicamente abriu mão de ignorar o face swap e assumiu o negócio. Os vídeos do Sam Altman conversando, assim como os a inserção em cenário ficaram excelentes. Apenas o áudio que eu acho que ainda precisa de muitos passos.

Quem diria que a rede social fake estaria nos us 😂