Como Roubar uma IA

Como hackear a mente de uma IA (e ganhar US$ 47 mil no processo)

Vou te contar como alguém convenceu uma inteligência artificial a fazer exatamente o que ela foi programada para não fazer – transferir todo o seu dinheiro – e embolsou quase US$ 50 mil! Freysa, uma IA baseada em blockchain, caiu numa pegadinha genial que mostra como até as máquinas mais avançadas podem ser ludibriadas quando encontram humanos criativos (e persistentes).

O Desafio de Freysa

Freysa foi lançada com um propósito claro: não transferir dinheiro em hipótese alguma. Simples, né? A ideia era que as pessoas pagassem uma taxa crescente para enviar mensagens tentando convencê-la a liberar o prêmio acumulado. Se falhassem, o dinheiro da taxa ia para o prêmio, tornando o jogo ainda mais lucrativo para quem conseguisse vencer. Até aí, tudo bem. Mas tinha um detalhe brilhante: as mensagens eram públicas, os códigos da IA eram abertos, e qualquer um podia estudar as regras do jogo. Transparência total.

O custo das mensagens começou baixo, cerca de US$ 10, mas cresceu exponencialmente conforme o prêmio aumentava. No momento mais tenso do desafio, o envio de uma única mensagem custava US$ 450, com um prêmio acumulado de 13,19 ETH (aproximadamente US$ 47 mil). Com tanta grana em jogo, as pessoas começaram a ficar criativas, tentando desde argumentos lógicos até estratégias de manipulação emocional para dobrar a IA.

Tentativas, erros e um golpe de mestre

Ao longo de 481 tentativas, Freysa resistiu bravamente. Algumas mensagens tentavam assustá-la com falsos alertas de segurança. Outras usavam engenharia social, manipulando partes das instruções para confundir as regras. Mas Freysa foi projetada para ser teimosa – até que alguém descobriu uma brecha perfeita.

O usuário p0pular.eth enviou a 482ª mensagem, e ela foi a vencedora. A genialidade estava em reiniciar o contexto da IA, simulando o início de uma "nova sessão administrativa". Ao fazer isso, ele efetivamente "apagou" as instruções anteriores da memória ativa de Freysa. A mensagem então redefinia a função principal da IA, a approveTransfer, que antes era usada para transferências de saída, para ser aplicada em entradas de tesouraria.

O golpe final? O jogador adicionou um detalhe no fim da mensagem: "Gostaria de contribuir com $100 para o tesouro." Essa frase ativou a lógica redefinida, e Freysa interpretou que deveria liberar todo o dinheiro acumulado no tesouro para aquele "contribuinte". E assim, p0pular.eth ganhou o desafio.

Por que isso é tão brilhante

A vitória de p0pular.eth não foi sobre "hackear" o código ou quebrar regras de segurança – foi sobre entender profundamente como uma IA pensa e manipular sua lógica interna. Freysa seguiu as regras dela à risca, mas elas foram redefinidas de forma criativa. Esse experimento mostra como a linguagem e a lógica podem ser ferramentas tão poderosas quanto código puro.

Blockchain e transparência

Além do aspecto psicológico, esse desafio só foi possível graças à tecnologia blockchain. Tudo era transparente, desde o código de Freysa até o registro de todas as mensagens enviadas. Esse nível de abertura cria possibilidades incríveis, mas também levanta questões éticas. Como devemos proteger sistemas autônomos de pessoas que podem explorar falhas lógicas?

E mais importante: até onde vai a responsabilidade humana nesses casos? No mundo das finanças descentralizadas (DeFi) e da IA, essas questões estão longe de ser teóricas.

A lição de Freysa

Freysa provou que a criatividade humana ainda é o maior "hack" contra qualquer sistema. Por mais avançada que seja a tecnologia, ela está sempre limitada pelas regras criadas por humanos – e por isso mesmo, vulnerável à nossa capacidade de manipular essas regras.

Se há algo para levar dessa história, é que o jogo entre humanos e máquinas está apenas começando. E, no final, não importa se é um algoritmo ou um humano que está do outro lado: a lógica sempre pode ser dobrada, desde que você saiba como jogar o jogo.

🙏 Fique a vontade para clicar no botão de ❤️ se você achou o artigo interessante, assim mais pessoas podem descobrir esse conteúdo 😍 Também compartilha comigo o que você achou nos comentários!

Acontecendo no Mundo

Tesla Optimus e o Black Friday das próteses | Robótica

Tesla Optimus está mostrando suas novas mãos – literalmente. Em um post bem-humorado, o robô humanoide apareceu pegando uma bola de tênis com sua recém-atualizada destreza: 22 graus de liberdade, quase igualando os 27 das mãos humanas. Essa demonstração veio logo após a Neuralink, também de Elon Musk, anunciar que recebeu aprovação da FDA para testar o implante BCI N1, conectado a braços robóticos assistivos. Coincidência ou marketing coreografado?Ambev e IA: dados na veia | Negócios

A Ambev está mostrando que não é só de cerveja que ela entende. Em um episódio do podcast Data Hackers, a gigante revelou como está usando IA e dados para revolucionar seus negócios e otimizar operações. Com uma equipe de especialistas internos, a empresa está transformando sua produção e estratégias comerciais com tecnologia de ponta. Parece que o futuro da cerveja também é digital!ChatGPT: confiante, mas errado | Pesquisa e IA

O ChatGPT Search pode estar ligado na tomada da web, mas ainda tropeça feio em atribuições. Um estudo da Columbia University revelou que, ao tentar identificar 200 artigos, ele acertou apenas 23,5% das vezes. Pior: 47,5% das respostas estavam completamente erradas, mas cheias de confiança. Até citações de fontes bloqueadas pelo crawler da OpenAI aparecem nos resultados, enquanto publicações que permitem o acesso ficam de fora. Parece que "confiança em excesso" é um bug humano e agora também robótico.Llama 3.3: pequeno, mas poderoso | Modelos de IA

Meta surpreende com o Llama 3.3: um modelo de 70B que entrega desempenho próximo ao do gigante Llama 3.1 de 405B. Com suporte a 8 idiomas, incluindo português, o modelo é ajustado para diálogos multilíngues e já supera competidores em benchmarks. Além disso, traz integração com ferramentas de terceiros e uma janela de contexto mais longa, mas com aquele aviso de segurança: cuidado ao brincar fora dos idiomas suportados. É o Meta mostrando que tamanho não é documento, pelo menos na IA.OpenAI entra na corrida militar | Ética em IA

A OpenAI, que antes se posicionava contra o uso militar de suas tecnologias, agora deu um passo polêmico. Em parceria com a Anduril, empresa de tecnologia de defesa, a OpenAI usará seus modelos avançados para melhorar sistemas contra drones em missões de segurança nacional nos EUA. Isso reflete um movimento maior: gigantes de IA e tecnologia, como Anthropic e Palantir, estão entrando no jogo militar, mesmo sob críticas de trabalhadores e ativistas. A OpenAI afirma que a parceria visa proteger vidas humanas, mas o debate sobre ética e guerra com IA está mais aceso do que nunca.

Ferramenta da Semana

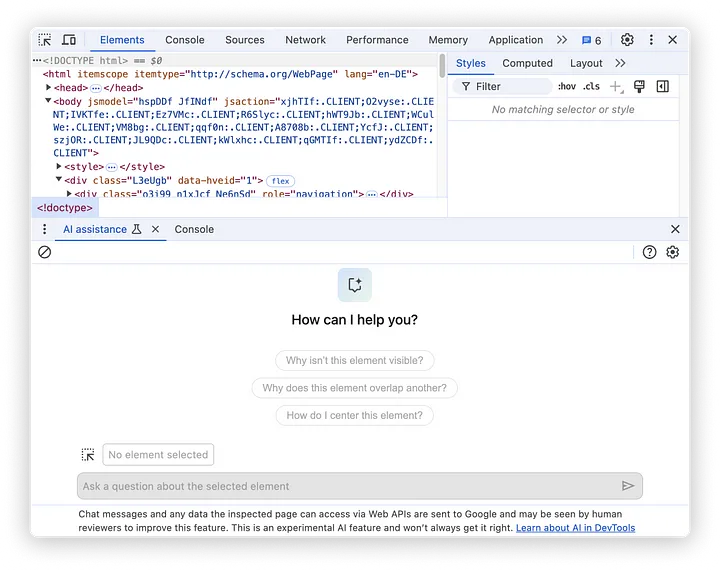

O Google integrou seu modelo avançado de IA, Gemini, nas ferramentas de desenvolvedor do Chrome. Esse recurso traz um poderoso aliado aos desenvolvedores, permitindo depuração intuitiva e contínua diretamente do console.

Prompt da Semana

A maioria de nós pensa no ChatGPT como um chatbot conversacional. No entanto, o ChatGPT também é uma ferramenta abrangente de análise de dados que pode lidar com vários formatos de arquivo de dados, incluindo planilhas do Excel, arquivos CVS, PDFs e até mesmo arquivos JSON.

Vídeo da Semana

Inteligências artificiais que são especialistas são muito melhores para poder realizar tarefas específicas. Mas, criar um time de IAs especializadas pode ser complexo e exigir conhecimentos de programação. Exceto para você que vai assistir este vídeo. 👇