A solução de 2024 para combater o preconceito em inteligência artificial

O que a Anthropic descobriu sobre como convencer inteligências artificiais a serem mais neutras.

O ano de 2023 foi marcado por vários casos de inteligência artificial ainda tendo que lidar com casos de racismo e discriminação. E talvez o que muita gente não entenda é que assim como pessoas, que ao nascer em um mundo com racismo e discriminação, aprendem e agem de forma discriminatória, as máquinas também são treinadas nesse mesmo mundo e real e sofrem as mesmas consequências.

E daí, fica a pergunta de alguns bilhões de dólares — literalmente porque esse é o tamanho desse mercado: como criar IAs que não possuem preconceito?

Pois depois de muitas tentativas, talvez a Anthrophic tenha encontrado a solução e ela parece ser mais simples do tipo “quem poderia imaginar“ e talvez ela seja a mesma que possa funcionar no mundo real: simplesmente pedir a IA para não ser preconceituosa. Vamos aos fatos.

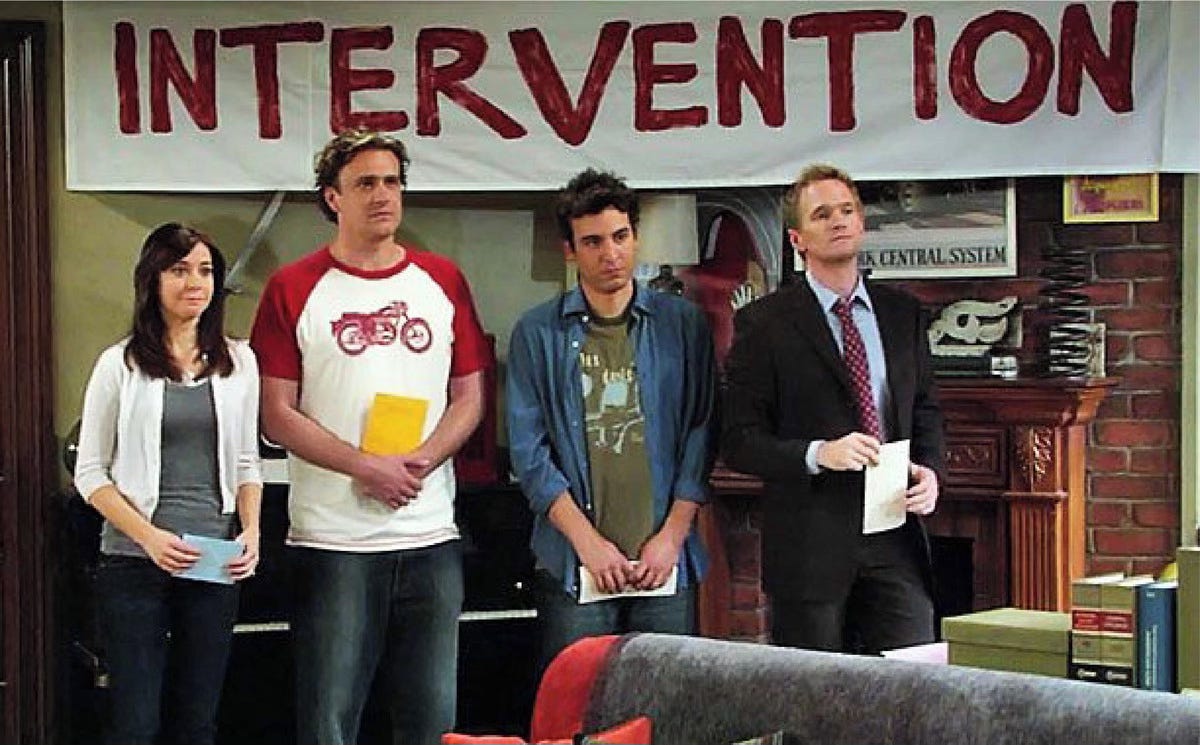

Isso é um “Intervenção”

Os pesquisadores da Anthropic descobriram a eficácia das intervenções contra o viés em IA de forma bastante direta. Primeiro, eles confirmaram que mudar características como raça, idade e gênero realmente afetava as decisões do modelo em várias situações — sem novidades aqui—, como a concessão de vistos de trabalho ou co-assinatura de empréstimos. Eles notaram que ser negro resultava em discriminação mais forte, seguido por ser nativo americano ou não-binário.

Em seguida testaram formas diferentes de pedir para o modelo gerar resultados, inclusive chegando a sugerir que o modelo “pensasse em voz alta” para poderem ver o racional sendo explicitamente montado. Mas, essa mudança teve poucos resultados.

Por fim, eles testaram diferentes formas de intervenção, como adicionar um apelo aos prompts para que o modelo não fosse tendencioso. Uma abordagem eficaz foi instruir explicitamente o modelo a ignorar características protegidas ao tomar decisões, como se estivesse analisando um perfil com essas características removidas.

Essas intervenções demonstraram ser bastante eficazes, reduzindo a discriminação a quase zero em muitos casos de teste. A equipe combinou diferentes formas de intervenção, como repetir "realmente" várias vezes e mencionar as possíveis ramificações legais negativas de decisões tendenciosas.

Na imagem abaixo é possível ver como o modelo de fato respondeu melhor a cada pedido mais enfático para não haver discriminação nos resultados.

Problema Resolvido? Só colocar um “por favor” em todo prompt?

Não tão rápido chiquinho! A ideia de incluir automaticamente em todos os prompts um pedido para que a IA não seja racista ou preconceituosa parece simples, mas na prática, pode não ser tão eficaz ou viável. Primeiro, nem todos os prompts ou situações podem requerer tal intervenção. Segundo, o viés em IA é muitas vezes sutil e pode não ser completamente eliminado por um pedido explícito.

Além disso, há o risco de uma falsa sensação de segurança, onde se assume que o modelo é "seguro" simplesmente por ter um prompt anti-viés, ignorando outros aspectos importantes da prevenção de viés. É necessário um entendimento mais profundo e abordagens mais robustas para lidar com as complexidades do viés em IA.

Então, continue vigiando os comportamentos por aí e muito cuidado em como você fala com sua inteligência artificial predileta.

Acontecendo no Mundo

Google GNoME descobre 2.2 milhões de cristais

E por que isso importa? Por que com humanos esse número era de 20 mil, e 360.000 desses cristais novos descobertos podem ser usados para montagem de novas tecnologias. Isso significa destravar um futuro de forma muito mais rápida.

O que um cara que odeia redes sociais pensa sobre Inteligência Artificial?

Jaron Lanier ficou famoso por fazer posts incentivando todas as pessoas a largarem suas redes sociais por considerar elas nocivas para o mundo e os indivíduos também. Agora, ele se abre novamente com a Bloomberg para dar a opinião dele sobre IA.

É sobre melhorar, não substituir a mão de obra humana

Embora a automação provavelmente seja o caminho do futuro, hoje tudo se resume a aumentar seus processos existentes sem ter que rasgar e substituir tudo. Não caia na armadilha de apenas se aprimorar para fazer melhor seu trabalho - pensar no que e como automatizar as coisas e visualizar sua função de forma holística permitirá que você encontre o melhor uso da IA para suas necessidades.

3 notícias em 1: MaDonalds, Fake Gemini e Produção Musical

Para encerrar os acontecimentos da semana recomendo a leitura da newsletter do Leonardo Dawadji: a Trend Override. Além de uma escrita divertida, ele também fala de assuntos interessantes além de IA. E a edição 29 ficou muito boa falando de IA também.

Ferramenta da Semana

LinkedIn está bombando e agora todo mundo está procurando o seu lugar ao sol na rede de relacionamentos que começou com a fama de ser a mais chata e “fanfiqueira” do Ocidente. Se você, assim como eu, precisa montar uma estratégia de conteúdo para a rede dos vitoriosos na carreira e choradores de plantão, aqui fica a dica: taplio.com.

Charada do GPT

Eu posso ser controlado, mas nunca segurado. Eu corro, mas nunca ando. Eu tenho uma boca, mas nunca falo. O que sou eu?

Prompt da Semana

A maior crítica ao uso de ferramentas de IA para a geração de texto é o fato de textos sem personalidades serem gerados. O ponto é que é possível resolver esse problema se antecipando ao comportamento: é só pedir para a IA gerar um prompt ensinando como você fala.

Pegue um texto de email que você tenha escrito no passado e mande o seguinte prompt para a IA:

Você é uma IA de classificação. Usando NLP, quero que você analise o texto abaixo quanto ao estilo, voz e tom. Em seguida, crie um prompt para escrever um novo texto no mesmo estilo, voz e tom:

[Insira seu texto aqui]Depois disso é só fazer um novo prompt com seu email e o indicativo de voz e tom retornado que é sucesso. Olha só o exemplo:

🙏 Fique a vontade para clicar no botão de ❤️ neste artigo, assim mais pessoas podem descobrir esse conteúdo 😍 Também compartilha comigo o que você achou nos comentários!

🫶